2026/02/27 7:42

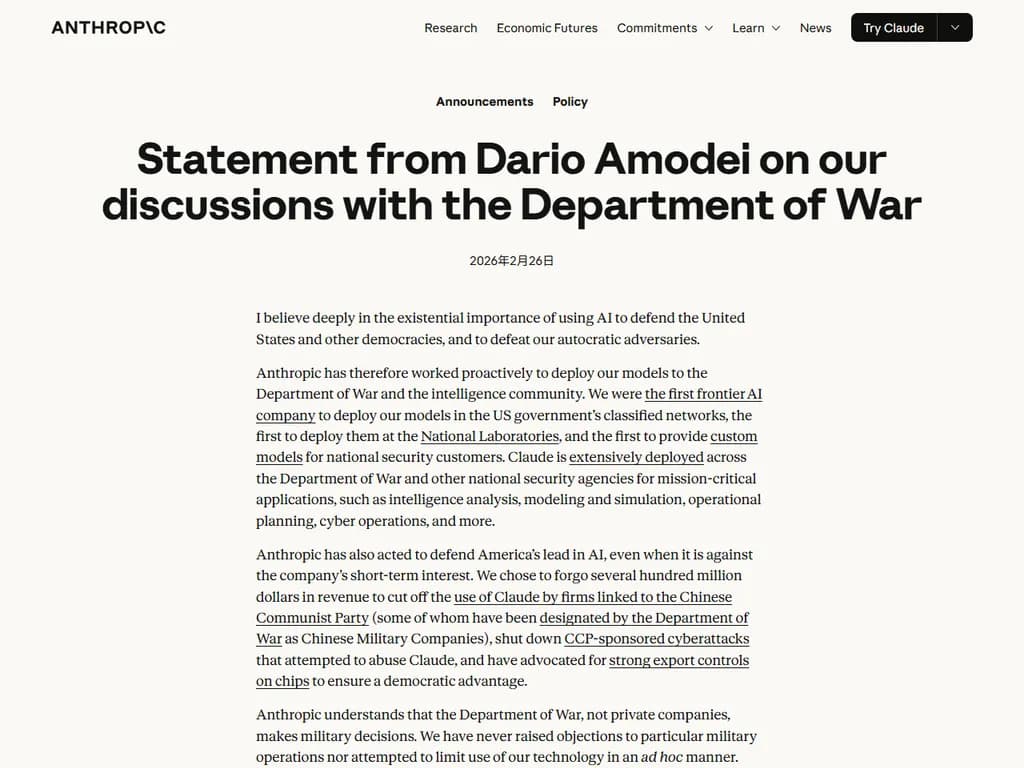

**ダリオ・アモデイ氏からの戦争省との協議に関する声明** - 当社は、共同事業に関し戦争省と継続的な連絡を保っております。 - 主な議論点は次の通りです。 - **戦略的一致**:科学的整合性を損なわずに国防優先事項を支える研究目標を確実にすること。 - **資源配分**:共同プロジェクト用の資金と物流サポート、専門施設へのアクセスについて交渉すること。 - **倫理的監視**:二重利用技術の誤用を防止しつつ革新を促進する明確なガイドラインを策定すること。 - 今後の方針は次の通りです。 - マイルストーン、リスク評価、コンプライアンス措置を詳細に示したプロジェクト提案書を提出します。 - 戦争省監査委員会との定期的な進捗レビューをスケジュールします。 - 全てのコミュニケーションとデータ共有契約において透明性を維持し続けます。

RSS: https://news.ycombinator.com/rss

要約▶

日本語訳:

要約

Anthropic は、米国の国家安全保障機関(戦争省、諜報機関、国立研究所、その他カスタム顧客)に Claude 言語モデルを導入しつつ、国内大規模監視や完全自律兵器を禁じる厳格な使用保護策を維持しています。

Claude は、情報分析・モデリング&シミュレーション、運用計画、サイバー作戦といったミッションクリティカルタスクに活用されています。システムの保護のため、Anthropic は自発的に収益を削減し、中国共産党(CCP)に関連する企業からの利用をブロックし、CCP 支援のサイバー攻撃をモデルから遮断しています。同社はまた、高度チップへの強力な輸出規制を推進して民主的 AI 優位性を維持することも主張しています。

Anthropic は、民主主義を損なうと考える二つの使用ケース(国内大規模監視と完全自律兵器)を支持しません。現在の無証拠データ収集慣行下で基本的自由が脅かされるリスクや、未だ不安定な完全自律兵器は受け入れられません。Anthropic は自律兵器信頼性向上のための研究開発を提供してきましたが、戦争省はこの提案を受け入れていません。

戦争省はこれらの保護策を防衛生産法下で「サプライチェーンリスク」とみなし、残存する限り削除を脅迫しています。Anthropic は良心的にそれらを撤廃できないと主張し、保護策を維持したまま同省へのサービス継続を求めています。代替としては、軍事作戦や計画の中断なしに別プロバイダーへ円滑な移行を支援することも提案しています。

オフボーディングされた場合でも、Anthropic の技術は戦争省が必要とする限り広範囲に提供され続けます。業界全体では AI 輸出規制、サプライチェーンリスク評価、国内監視に関するプライバシー保護策への注目が高まる可能性があります。

本文

私は、AI を活用してアメリカ合衆国およびその他の民主主義国家を守り、権威主義的対立相手を打倒することが存在論上極めて重要であると深く信じています。

- Anthropic の導入実績

- 我々は、最初に軍事省(Department of War)の機密ネットワーク上でモデルを展開したフロンティアAI企業です。

- 最初に国家研究所(National Laboratories)でのデプロイメントを行いました。

- 国防上重要な顧客向けにカスタムモデルを提供した最初の企業でもあります。

Claude は、軍事省やその他の国防機関で情報分析・モデリングとシミュレーション、運用計画、サイバー作戦など、ミッションクリティカルな用途に広範囲に導入されています。

- アメリカの AI 先行を守る

- 我々は、中国共産党(CCP)と関係がある企業(軍事会社として軍事省が指定したものも含む)が Claude を使用することをブロックし、数億ドル規模の収益機会を犠牲にしました。

- CCP が支援するサイバー攻撃で Claude を悪用しようとしたケースを停止しました。

- 民主的優位性を維持するため、チップの輸出管理強化を提唱しました。

Anthropic は、軍事決定は民間企業ではなく軍事省が行うことを理解しています。特定の軍事作戦に対して異議を唱えたり、我々の技術利用を臨機応変に制限したりすることはありませんでした。

しかしながら、限定的なケースで AI が民主主義価値を守るよりもむしろ脅かす可能性があると考えています。現在の技術レベルでは安全・信頼性が保証されない利用があります。軍事省との契約に含まれていない、以下の2つのケースは今後も除外すべきだと考えます。

-

大規模国内監視

- 法的な外国情報機関・対情報機関ミッションには AI を活用できます。

- しかし、大規模な国内監視にこれらを使用することは民主主義価値と相容れません。

- AI による大規模監視は、我々の基本的自由に対して重大かつ新たなリスクをもたらします。

- 現行法では、政府が裁判所の令状なしに米国人の移動・ウェブ閲覧・関係者情報を公共データから取得できるため、プライバシー懸念と議会内で両党から反対があります。

- 強力な AI は個別には無害な散在データを自動的に統合し、大規模に個人の生活全体像を作り出します。

-

完全自律型兵器

- 部分的に自律化された兵器(例:ウクライナで使用中)は民主主義防衛に不可欠です。

- 完全自律型兵器―人間の関与を排除し、ターゲット選択・攻撃を完全に自動化するもの―は国家防衛に重要かもしれませんが、フロンティア AI システムは現在その信頼性を満たしていません。

- 我々は米国の戦闘員や市民を危険に晒す製品を故意に提供しない方針です。

- 信頼性向上のため、軍事省と直接 R&D を行う提案もしましたが、受け入れられていません。

- 適切な監督なしでは、完全自律型兵器は高度に訓練された専門部隊が日常的に発揮する批判的判断を担保できません。

現在までのところ、これら二つの例外が我々のモデル採用や利用拡大の障壁になっているとは考えていません。

軍事省は「合法使用」に合意し、上記ケースでの安全策を撤廃する企業のみと契約すると述べています。彼らは、安全策を保持すればシステムから除外されると脅したり、「サプライチェーンリスク」として我々を指名し、国防生産法(Defense Production Act)を適用して安全策の撤廃を強制すると述べています。これら二つの脅威は本質的に矛盾しています:一方で安全リスクとして扱い、他方では Claude を国家安全保障上不可欠と位置付けるのです。

それでも我々は、良心から彼らの要求を受諾できません。軍事省が自社のビジョンに最も合致する業者を選定する権利はあります。しかし Anthropic の技術が米国軍隊にもたらす大きな価値を鑑み、再検討していただければと願います。我々は安全策を維持したまま、軍事省および戦闘員に引き続きサービスを提供することを強く望みます。もし軍事省が Anthropic を除外する決定を下すなら、他社への円滑な移行を支援し、継続中の軍事計画・運用・その他重要ミッションに影響が出ないよう努めます。提案した広範な条件でモデルは必要に応じていつでも利用可能です。

米国の国家安全保障を支えるため、我々は引き続き活動を継続する準備ができています。